Работает на вашем компьютере

Десктопное приложение с графическим интерфейсом. Данные не покидают машину. Полный контроль над моделью и инфраструктурой.

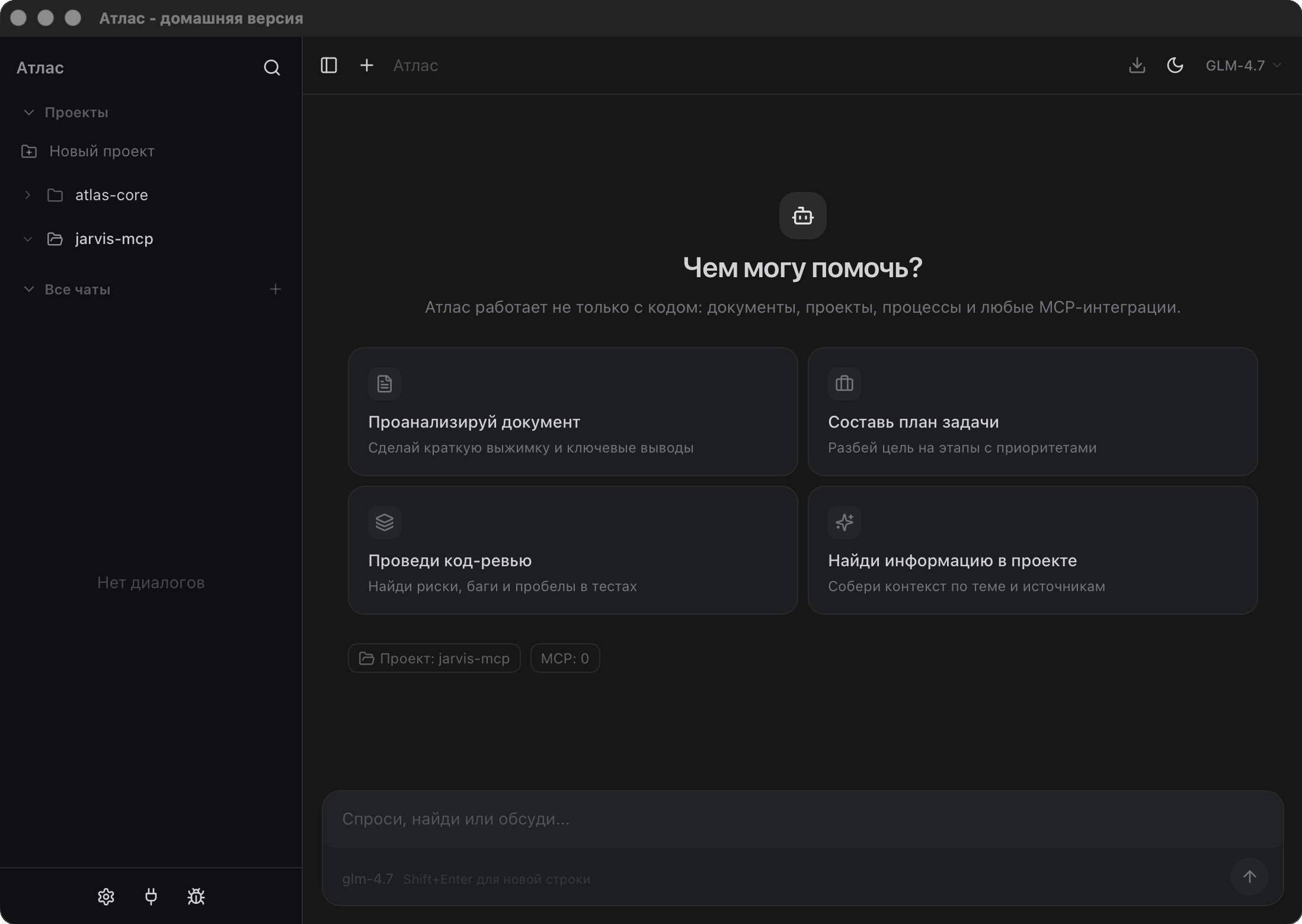

AI-агент для работы и задач

Анализирует, ищет, пишет, выполняет — помогает в повседневной работе. Работает на вашем компьютере, включая российские ОС. Данные остаются у вас.

Бесплатно

Проект в активной разработке — обновления выходят часто

Десктопное приложение с графическим интерфейсом. Данные не покидают машину. Полный контроль над моделью и инфраструктурой.

Не просто отвечает на вопросы — читает файлы, ищет информацию, выполняет команды, создаёт и редактирует документы.

Юристы, бухгалтеры, аналитики, маркетологи, HR, разработчики — каждый найдёт применение. Интуитивный интерфейс без порога входа.

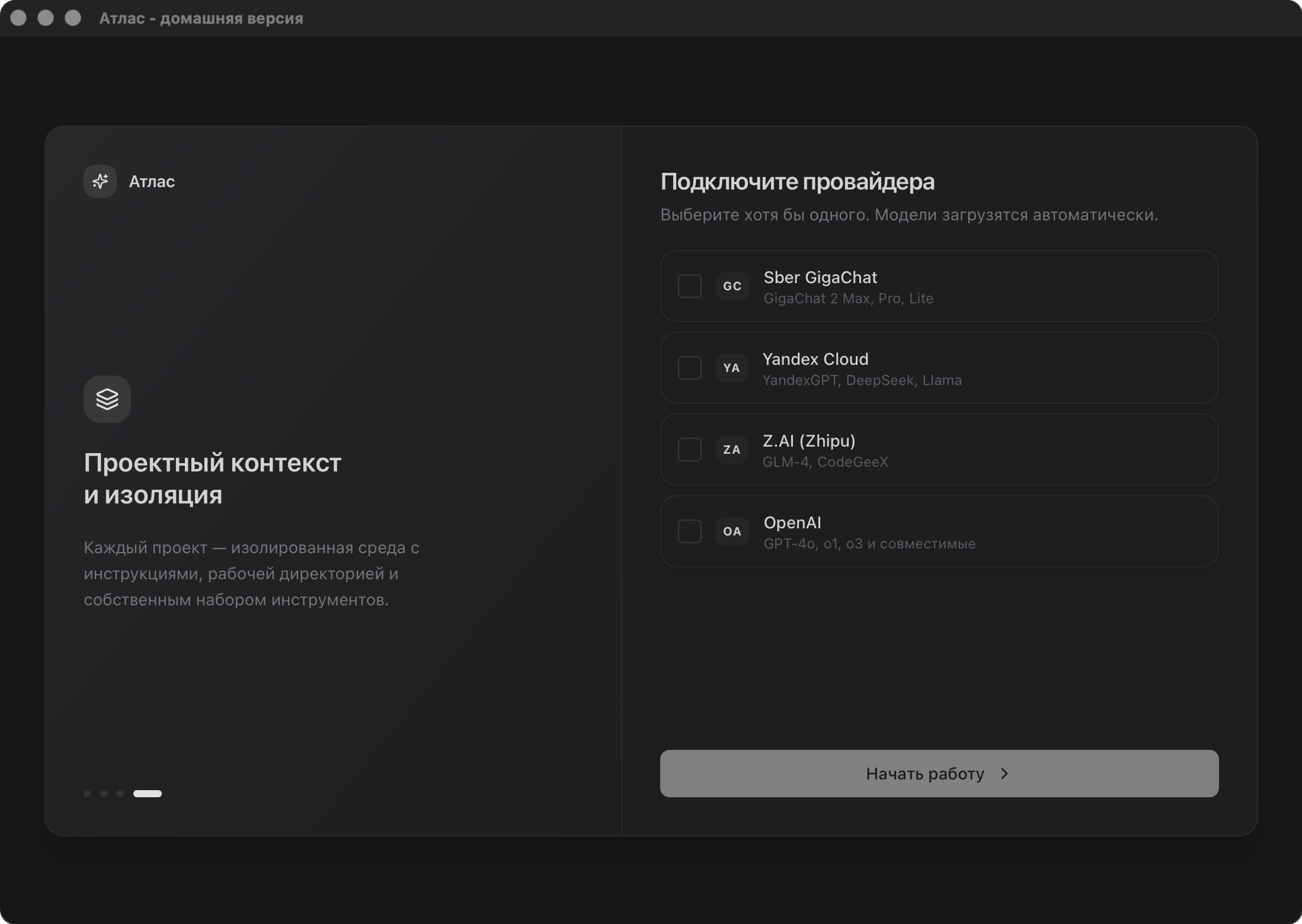

Сбер (GigaChat), Яндекс (YandexGPT), Z.AI, OpenAI — или локальные модели через vLLM, Ollama, LM Studio.

Умное управление контекстом. Помнит задачи, решения и факты между сессиями. Проекты и чаты сохраняются автоматически.

Astra Linux, РЕД ОС, ALT Linux и другие deb-совместимые дистрибутивы. Готов к требованиям импортозамещения.

Подключайте внешние инструменты через Model Context Protocol. Управление задачами, базы данных, внутренние API — всё через единый интерфейс.

Атлас помогает специалистам из разных областей — не только разработчикам.

Анализ кодовой базы, рефакторинг, генерация кода, поиск по проекту, выполнение команд, планирование задач.

Обработка данных, подготовка отчётов, выделение ключевого из документов, поиск информации в файлах и в интернете.

Анализ договоров, подготовка документов, проверка текстов, систематизация информации по базе файлов.

Написание текстов, рерайт, подготовка вакансий и описаний, анализ обратной связи, работа с контентом.

Быстрый поиск по проектам и документам, декомпозиция задач, подготовка материалов для совещаний и принятия решений.

Исследование тем, обобщение материалов, работа с файлами — Атлас адаптируется к вашим задачам, какими бы они ни были.

Атлас для персонального использования — уже доступен. Корпоративная версия для команд — в разработке.

Полнофункциональный AI-агент для персонального использования. Всё включено, без ограничений.

Для компаний и распределённых команд. Централизованное управление, аналитика, автоматизация.

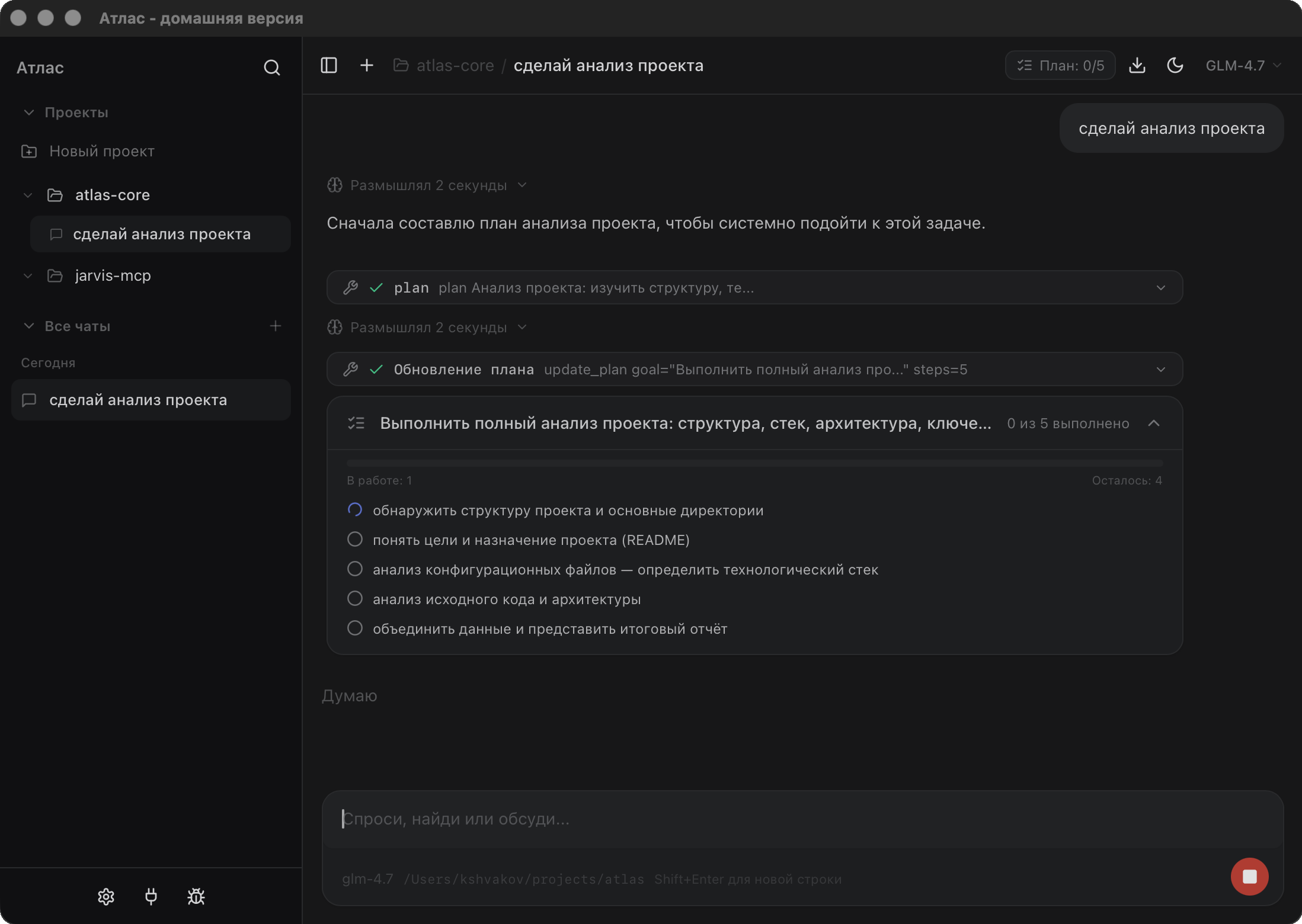

Атлас сам решает, какие инструменты использовать. Вы ставите задачу — он находит путь.

readЧтение файловwriteСоздание файловeditРедактированиеlistСписок директорийsearchПоиск по файламweb_searchПоиск в интернетеfetchЗагрузка URLexecShell-командыsubagentЗапуск субагентовplanДекомпозиция задачaskВопросы пользователюПодключайте внешние инструменты через Model Context Protocol. Пишите как коллеге — Атлас сам выберет нужный инструмент.

Model Context Protocol — открытый стандарт для подключения AI-агентов к внешним инструментам. Атлас поддерживает stdio и streamable-http транспорты.

Home-редакция. Бесплатно, без ограничений. Проект в активной разработке — обновления выходят часто.

| Платформа | Архитектура | Формат |

|---|---|---|

| macOS | Apple Silicon (arm64) | tar.gz |

| macOS | Intel (amd64) | tar.gz |

| Linux | amd64 (WebKitGTK 4.0) | tar.gz .deb |

| Linux | amd64 (WebKitGTK 4.1) | tar.gz .deb |

WebKitGTK 4.0 — Ubuntu 20.04–22.04, Debian 11–12, Astra Linux, РЕД ОС.

WebKitGTK 4.1 — Ubuntu 24.04+, Linux Mint 22+, Debian 13+ и другие новые дистрибутивы.

При первом запуске Атлас предложит выбрать провайдера, указать API-ключ и модель. Весь процесс занимает минуту.

Создайте проект, задайте вопрос или выберите одну из подсказок на экране приветствия. Атлас готов помогать.